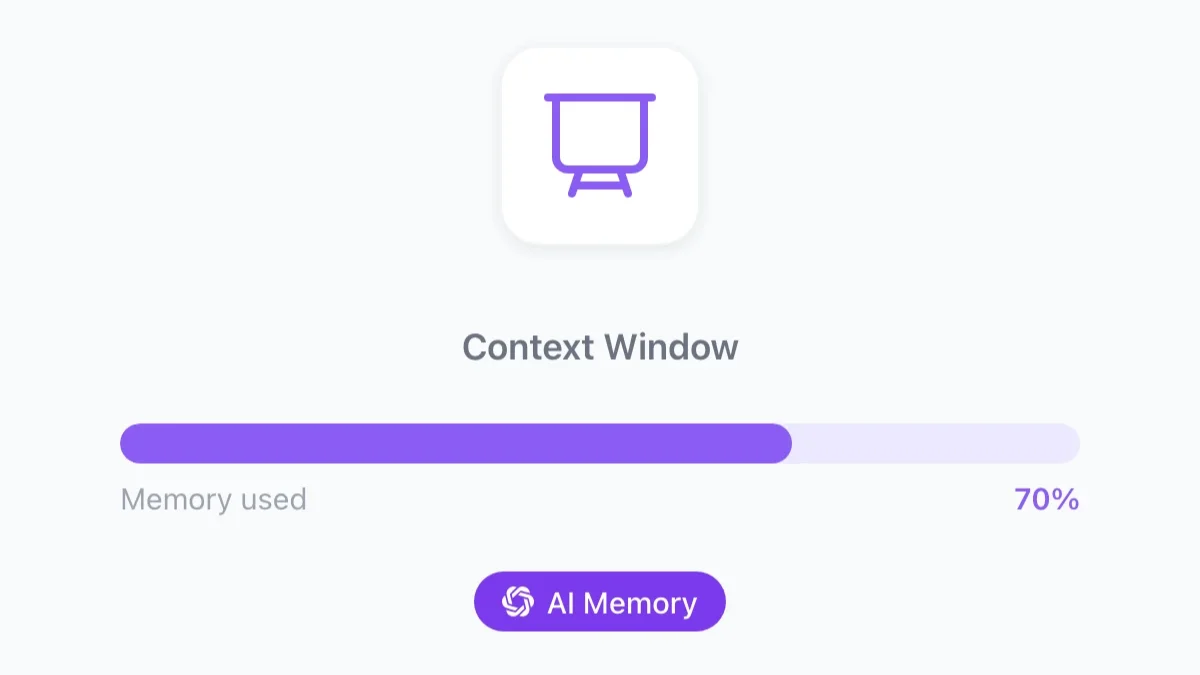

上下文窗口:你AI的“记忆”

LLM理解的核心当你与像ChatGPT这样的大型语言模型(LLM)互动时,它确实能记住当前对话中你过去的消息。这种能力主要归功于所谓的“上下文窗口”。AI模型的工作记忆类似于人类的短期记忆或计算机的RAM。正如短期记忆帮助我们暂时保存和处理信息,RAM让计算机快速访问当前所需的数据一样,AI的工作记忆决定了它能同时处理多少信息。这种容量限制了AI在回答问题时能考虑多少上下文,就像我们的短期记忆或计算机的RAM设定了能同时处理内容的边界。

LLM理解的核心

当你与像ChatGPT这样的大型语言模型(LLM)互动时,它确实能记住当前对话中你过去的消息。这种能力主要归功于所谓的“上下文窗口”。AI模型的工作记忆类似于人类的短期记忆或计算机的RAM。正如短期记忆帮助我们暂时保存和处理信息,RAM让计算机快速访问当前所需的数据一样,AI的工作记忆决定了它能同时处理多少信息。这种容量限制了AI在回答问题时能考虑多少上下文,就像我们的短期记忆或计算机的RAM设定了能同时处理内容的边界。

简单来说,你可以把上下文窗口想象成AI能同时“阅读”和“记住”的文本量。这个窗口越大,AI就能从你的对话中记住更多细节,或者分析更长的文档而不会“忘记”之前的内容。

什么是上下文窗口?

与人类处理单词不同,LLM将文本分解为“令牌”。一个令牌可以是一个字符、单词的一部分、一个完整的单词,甚至是一个短短语。例如,单词“amoral”可能有两个令牌:“a”和“moral”。

上下文窗口的大小总是以令牌来衡量。平均而言,一个英文单词大约相当于1.5个令牌。需要注意的是,上下文窗口不仅仅用于你的文本;它还包括系统指令(称为“系统提示”)、用于检索增强生成(RAG)的额外信息以及格式化元素。系统提示是给AI的指令,用于指导其行为或回应方式。例如,如果你要求AI以专业方式回复,该命令就是一个系统提示:“请以专业和礼貌的语气回答所有问题。”

为什么它如此重要?

更大的上下文窗口为LLM带来了显著优势:

改进的信息保留能力:AI能在整个对话中记住更多细节,防止“迷失方向”。

处理更长文本:模型可以分析和总结更长的文档、代码库或数据集,这在以前是不可能的。

高级推理能力:增加的上下文允许更准确、复杂和细致的回应。例如,Google的Gemini 1.5 Pro模型通过阅读其唯一的语法手册,学会了翻译一种极度濒危的语言(Kalamang),展示了与人类相当的翻译能力。

新的互动可能性:增加的数据处理能力为用户与AI互动开辟了全新的方式,支持更复杂和全面的任务。

大上下文窗口的挑战

尽管有诸多好处,大上下文窗口也带来了挑战:

计算成本和功耗:处理更大的文本块需要显著更多的计算能力、内存和时间。将上下文长度加倍可能使计算需求翻两番。

延迟:随着上下文长度的增加,推理可能变慢,这对实时应用来说是个问题。

“大海捞针”问题:随着文本量(“干草堆”)的增加,模型可能难以定位特定、关键的细节(“针”)。其注意力被稀释,导致它忽略了关键事实——就像在200页的报告中漏掉了关于项目关键失败的一句话。这大大降低了模型的可靠性和准确性。

要深入了解,请参阅关于此问题的基础论文:https://arxiv.org/abs/2307.03172

能力的演变

随着时间的推移,上下文窗口的大小显著增长,标志着AI系统在更深理解和更广泛情境感知方面迈出了重要一步。虽然早期的LLM如GPT-2仅限于约2,048个令牌,但现代模型的能力已经爆炸式增长。

如今,像Anthropic的Claude 3这样的模型提供了200,000个令牌的窗口。OpenAI的GPT-4 Turbo和GPT-4o达到128,000个令牌。Google Gemini 1.5 Pro拥有标准的128,000个令牌窗口,实验版本高达100万个令牌,研究测试甚至达到1000万个令牌。像Magic AI这样的项目甚至瞄准了1亿个令牌。这种增加上下文的竞赛是AI领域创新和竞争的关键指标。

下表说明了上下文窗口能力的演变:

| 模型 | 上下文窗口(令牌) | 发布年份 | 关键特性 |

|---|---|---|---|

| GPT-4 Turbo | 128,000 | 2023 | 优化、低成本版本 |

| GPT-4o (Omni) | 128,000 | 2024 | 多模态(文本、图像、音频) |

| Claude 3 Opus | 200,000 | 2024 | 扩展上下文,强大推理能力 |

| Claude 3.5/4 | 200,000 | 2024 | 最新的Anthropic模型 |

| Gemini 1.5 Pro | 128,000 (标准) / 1M (实验) | 2024 | 多模态,大上下文 |

| Gemini 2.0 / 2.5 Pro | 待定 | 2024+ | 增强能力 |

平衡能力与实用性

上下文窗口是大型语言模型“记忆”和理解的基础。其大小(以令牌衡量)直接影响LLM生成连贯文本和处理复杂任务的能力。

虽然更大的上下文窗口显著增强了AI能力,但它们也带来了与成本、性能和安全性相关的重大挑战。未来的LLM开发将继续专注于优化这一关键组件,寻求处理能力和实际可用性之间的“最佳平衡点”。因此,理解上下文窗口对于任何希望充分利用当前和未来AI工具的人来说都至关重要。

理解上下文窗口尤其与GPT Workspace相关,因为它直接影响我们当前模型——GPT-4.1和GPT-4o——能同时记住和处理多少信息。两种模型都提供了高达128,000个令牌的上下文窗口,使其非常适合扩展讨论、文档分析和复杂工作流。这种容量使用户能够利用长文档或互动,而不会频繁丢失过去的上下文,这对于在GPT Workspace中保持连贯、高效的会话至关重要。

在Google Workspace中体验大上下文窗口。 安装GPT Workspace,直接在Google Docs、Sheets、Slides和Gmail中使用具有128k上下文的GPT-4o。