La Ventana de Contexto: La "Memoria" de Tu IA

Cuando interactúas con un Modelo de Lenguaje Grande (LLM) como ChatGPT, recuerda genuinamente tus mensajes anteriores dentro de la conversación en curso. Esta habilidad se debe principalmente a lo que se llama la ventana de contexto.

El Núcleo de la Comprensión de los LLM

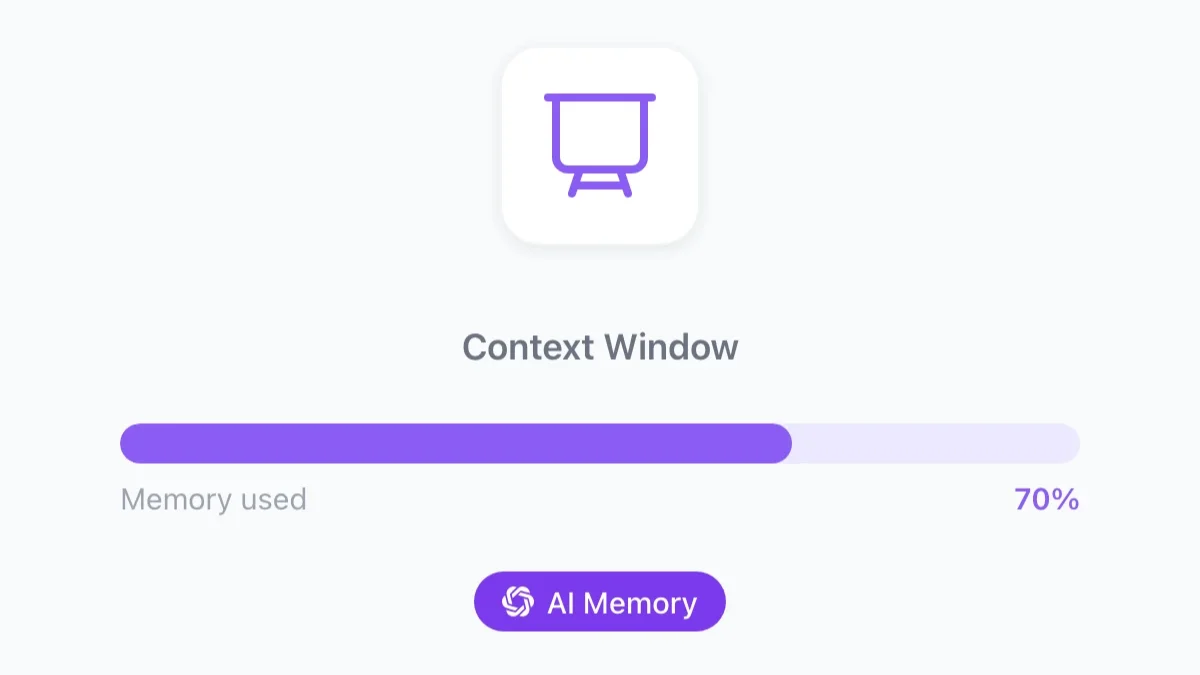

Cuando interactúas con un Modelo de Lenguaje Grande (LLM) como ChatGPT, este recuerda genuinamente tus mensajes anteriores dentro de la conversación en curso. Esta habilidad se debe principalmente a lo que se llama la “ventana de contexto”. La memoria de trabajo del modelo de IA es análoga a la memoria a corto plazo humana o la RAM de una computadora. Así como la memoria a corto plazo nos ayuda a retener y procesar información temporalmente, y la RAM permite a una computadora acceder rápidamente a los datos que necesita en el momento, la memoria de trabajo de una IA determina cuánta información puede manejar a la vez.

Dicho de manera simple, imagina la ventana de contexto como la cantidad de texto que la IA puede “leer” y “tener en mente” simultáneamente. Cuanto más grande sea esta ventana, más detalles puede recordar la IA de tu conversación o analizar de documentos largos sin “olvidar” lo que se dijo previamente.

¿Qué es la Ventana de Contexto?

A diferencia de los humanos que procesan palabras, los LLM descomponen el texto en “tokens”. Un token puede ser un solo carácter, parte de una palabra, una palabra completa o incluso una frase corta. Por ejemplo, la palabra “amoral” podría tener dos tokens: “a” y “moral”.

El tamaño de la ventana de contexto siempre se mide en tokens. En promedio, una palabra en inglés es aproximadamente 1.5 tokens. Es importante tener en cuenta que la ventana de contexto no se usa únicamente para tu texto; también incluye elementos como instrucciones del sistema (llamadas “system prompts”), información adicional para la Generación Aumentada por Recuperación (RAG) y formato.

¿Por qué es tan importante?

Una ventana de contexto más grande ofrece ventajas significativas para los LLM:

Retención de Información Mejorada: La IA puede recordar más detalles a lo largo de una conversación, evitando “perder el hilo”.

Procesamiento de Textos Más Largos: Los modelos pueden analizar y resumir documentos, bases de código o conjuntos de datos mucho más grandes.

Razonamiento Avanzado: Un mayor contexto permite respuestas más precisas, complejas y matizadas.

Nuevas Posibilidades de Interacción: La mayor capacidad de manejo de datos abre formas completamente nuevas de interactuar con la IA.

Desafíos de las Ventanas de Contexto Grandes

A pesar de sus beneficios, las ventanas de contexto grandes presentan desafíos:

Costo y Potencia Computacional: Procesar bloques de texto más grandes demanda significativamente más potencia computacional, memoria y tiempo.

Latencia: La inferencia puede volverse más lenta a medida que aumenta la longitud del contexto.

El Problema de la “Aguja en un Pajar”: A medida que crece el volumen de texto, un modelo puede tener dificultades para identificar un detalle específico y crucial.

La Evolución de las Capacidades

Los tamaños de las ventanas de contexto han crecido significativamente con el tiempo. Mientras que los primeros LLM como GPT-2 estaban limitados a alrededor de 2,048 tokens, los modelos modernos han visto una explosión en sus capacidades.

Hoy, modelos como Claude 3 de Anthropic ofrecen una ventana de 200,000 tokens. GPT-4 Turbo y GPT-4o de OpenAI alcanzan 128,000 tokens. Google Gemini 1.5 Pro presenta una ventana estándar de 128,000 tokens, con una versión experimental que llega hasta 1 millón de tokens.

Equilibrando Potencia y Practicidad

La ventana de contexto es fundamental para la “memoria” y comprensión de los Modelos de Lenguaje Grande. Su tamaño, medido en tokens, impacta directamente la capacidad de un LLM para generar texto coherente y manejar tareas complejas.

Comprender la ventana de contexto es especialmente relevante para GPT Workspace, ya que influye directamente en cuánta información nuestros modelos actuales — GPT-4.1 y GPT-4o — pueden recordar y procesar a la vez. Ambos modelos ofrecen una ventana de contexto sustancial de hasta 128,000 tokens.

Experimenta ventanas de contexto grandes en Google Workspace. Instala GPT Workspace y usa GPT-4o con contexto de 128k directamente en Google Docs, Sheets, Slides y Gmail.