Comprendiendo los Tokens de OpenAI GPT: Una Guía Completa

Descubre el poder de los tokens de OpenAI GPT en esta guía completa. Aprende qué son los tokens, cómo contarlos y cómo usarlos para generar texto coherente y contextualmente relevante con los modelos GPT de OpenAI.

Los modelos OpenAI GPT se encuentran entre los modelos de lenguaje más potentes disponibles actualmente, con la capacidad de generar texto altamente coherente y contextualmente pertinente. Estos modelos emplean tokens como la unidad elemental para calcular la longitud de un texto. Pero, ¿qué son exactamente los tokens y cómo funcionan? En esta guía, profundizaremos en los detalles de los tokens de OpenAI GPT, discutiendo su definición, métodos para contarlos y sus aplicaciones prácticas.

Comprendiendo los Tokens de OpenAI GPT

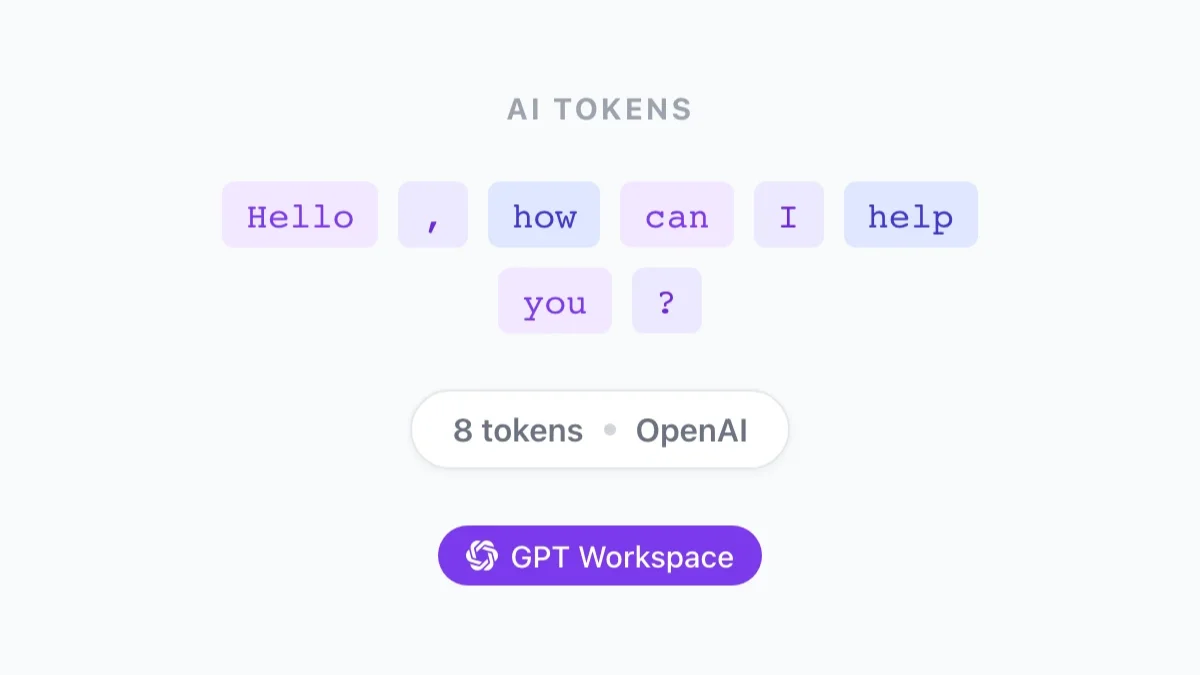

Los tokens en el contexto de los modelos OpenAI GPT son grupos de caracteres que representan la unidad fundamental del texto. Estos tokens son generados por un algoritmo tokenizador que segrega el texto en segmentos más pequeños siguiendo ciertas reglas, como espacios, signos de puntuación y caracteres especiales. Los tokens a veces pueden corresponder a palabras, pero no siempre, ya que el tokenizador contempla todos los caracteres, incluidos los emojis, como tokens potenciales.

Contando Tokens en Tu Texto

Para determinar el número de tokens en tu texto, debes tokenizarlo usando un algoritmo tokenizador. OpenAI proporciona un tokenizador oficial que puede ayudarte en este proceso. El número de tokens producidos por el tokenizador dependerá del idioma y el modelo específico utilizado. Sin embargo, como guía general, puedes usar las siguientes proporciones de palabras a tokens:

- Inglés: 1 palabra ≈ 1,3 tokens

- Español: 1 palabra ≈ 2 tokens

- Francés: 1 palabra ≈ 2 tokens

Es crucial reconocer que los signos de puntuación se cuentan como un token, mientras que los caracteres especiales y los emojis pueden contarse como uno a tres tokens y dos a tres tokens, respectivamente.

Aplicación Práctica de los Tokens

En los modelos OpenAI GPT, los tokens encuentran su uso en conjunto con el parámetro max_tokens para la generación de texto. El parámetro max_tokens estipula el número máximo de tokens que deben generarse en cualquier solicitud de API. El valor de max_tokens siempre debe cumplir con la siguiente restricción: prompt_tokens + max_tokens ≤ límite del modelo, donde prompt_tokens denota el número de tokens en el prompt.

El costo de un token dependerá del modelo específico utilizado, y se factura por cada 1000 tokens. Por ejemplo, el precio de 1000 tokens para ChatGPT es USD 0,0020, mientras que para GPT-4 con contexto de 32k, es USD 0,1200.

Conclusión

Los tokens son un concepto fundamental en los modelos OpenAI GPT, que simbolizan la unidad básica de texto empleada para generar texto contextualmente relevante y coherente. Al comprender la naturaleza de los tokens y su uso práctico, puedes desbloquear todo el potencial de los modelos OpenAI GPT y crear contenido cautivador que atraiga y eduque a tu audiencia.

¿Quieres usar los modelos GPT directamente en Google Workspace? Instala GPT Workspace — el complemento de Google Workspace que lleva OpenAI GPT a Google Docs, Sheets, Slides y Gmail de forma gratuita.