संदर्भ विंडो: आपके AI की "याददाश्त"

LLM समझ का मूल जब आप ChatGPT जैसे बड़े भाषा मॉडल (LLM) के साथ बातचीत करते हैं, तो यह वास्तव में चल रही बातचीत में आपके पिछले संदेशों को याद रखता है। यह क्षमता मुख्य रूप से उस 'संदर्भ विंडो' के कारण होती है।

LLM समझ का मूल

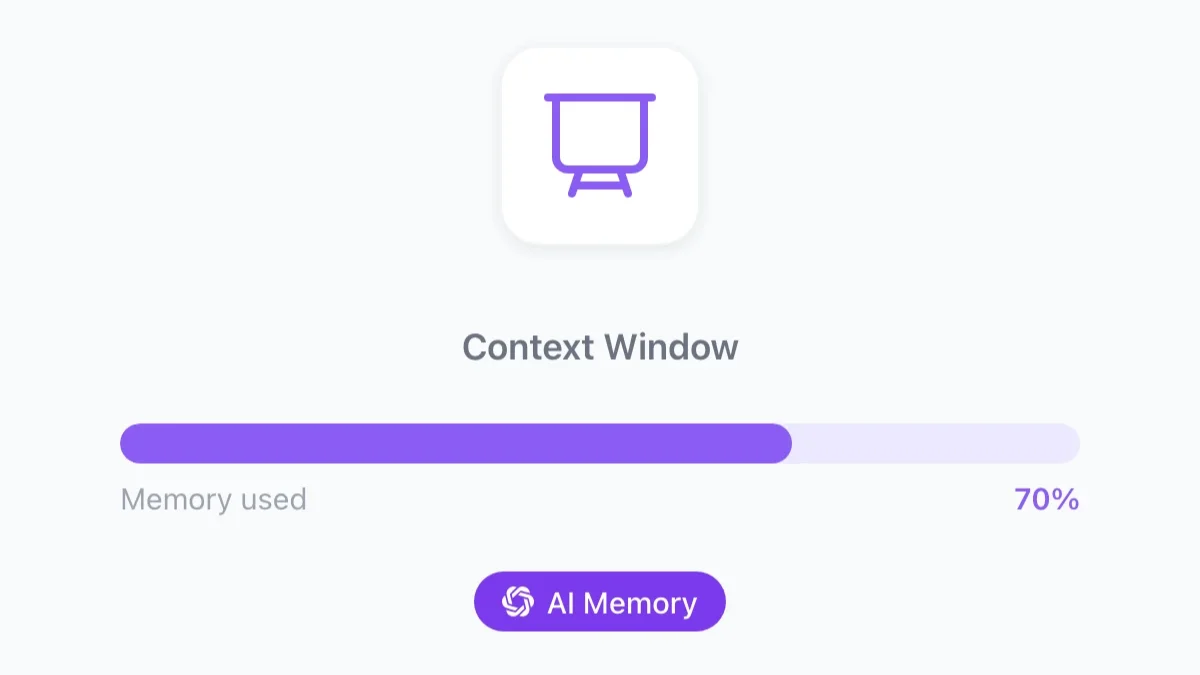

जब आप ChatGPT जैसे बड़े भाषा मॉडल (LLM) के साथ बातचीत करते हैं, तो यह वास्तव में चल रही बातचीत में आपके पिछले संदेशों को याद रखता है। यह क्षमता मुख्य रूप से उस “संदर्भ विंडो” के कारण होती है। AI मॉडल की कार्यशील स्मृति मानव की अल्पकालिक स्मृति या कंप्यूटर की RAM के समान है। जिस तरह अल्पकालिक स्मृति हमें अस्थायी रूप से जानकारी रखने और संसाधित करने में मदद करती है, और RAM कंप्यूटर को उस समय आवश्यक डेटा तक तेजी से पहुंचने देती है, उसी तरह AI की कार्यशील स्मृति यह निर्धारित करती है कि वह एक साथ कितनी जानकारी प्रबंधित कर सकता है। यह क्षमता उस सीमा को तय करती है कि AI प्रश्नों के उत्तर देते समय कितने संदर्भ पर विचार कर सकता है, ठीक वैसे ही जैसे हमारी अल्पकालिक स्मृति या कंप्यूटर की RAM एक साथ क्या संसाधित किया जा सकता है, इसकी सीमाएं तय करती है।

सरल शब्दों में, संदर्भ विंडो को उस पाठ की मात्रा के रूप में समझें जिसे AI एक साथ “पढ़” और “ध्यान में रख” सकता है। यह विंडो जितनी बड़ी होगी, AI आपकी बातचीत से उतने ही अधिक विवरण याद रख सकता है या लंबे दस्तावेज़ों का विश्लेषण कर सकता है, बिना यह “भूले” कि पहले क्या कहा गया था।

संदर्भ विंडो क्या है?

मनुष्यों के विपरीत जो शब्दों को संसाधित करते हैं, LLM पाठ को “टोकन” में तोड़ते हैं। एक टोकन एक एकल वर्ण, किसी शब्द का हिस्सा, एक पूरा शब्द या यहां तक कि एक छोटा वाक्यांश हो सकता है। उदाहरण के लिए, “amoral” शब्द के दो टोकन हो सकते हैं: “a” और “moral”।

संदर्भ विंडो का आकार हमेशा टोकन में मापा जाता है। औसतन, एक अंग्रेजी शब्द लगभग 1.5 टोकन का होता है। यह ध्यान रखना महत्वपूर्ण है कि संदर्भ विंडो का उपयोग केवल आपके पाठ के लिए ही नहीं होता; इसमें सिस्टम निर्देश (जिन्हें “सिस्टम प्रॉम्प्ट” कहा जाता है), रिट्रीवल ऑगमेंटेड जेनरेशन (RAG) के लिए अतिरिक्त जानकारी और फॉर्मेटिंग जैसे तत्व भी शामिल होते हैं। एक सिस्टम प्रॉम्प्ट AI को दिया गया एक निर्देश है जो यह मार्गदर्शन करता है कि उसे कैसे व्यवहार करना या प्रतिक्रिया देना चाहिए। उदाहरण के लिए, यदि आप AI से पेशेवर तरीके से जवाब देने के लिए कहते हैं, तो वह आदेश एक सिस्टम प्रॉम्प्ट है: “कृपया सभी प्रश्नों का उत्तर पेशेवर और विनम्र स्वर में दें।“

यह इतना महत्वपूर्ण क्यों है?

एक बड़ी संदर्भ विंडो LLM के लिए महत्वपूर्ण लाभ प्रदान करती है:

बेहतर सूचना प्रतिधारण: AI बातचीत के दौरान अधिक विवरण याद रख सकता है, जिससे वह “ट्रैक खोने” से बच जाता है।

लंबे पाठों का प्रसंस्करण: मॉडल बहुत बड़े दस्तावेज़ों, कोडबेस या डेटासेट का विश्लेषण और सारांशित कर सकते हैं, जो पहले असंभव था।

उन्नत तर्क: बढ़ा हुआ संदर्भ अधिक सटीक, जटिल और सूक्ष्म प्रतिक्रियाओं की अनुमति देता है। उदाहरण के लिए, Google के Gemini 1.5 Pro मॉडल ने एक गंभीर रूप से लुप्तप्राय भाषा (कलामांग) के एकमात्र व्याकरण मैनुअल को पढ़कर उसका अनुवाद करना सीख लिया, जिससे मानव के बराबर अनुवाद क्षमता का प्रदर्शन हुआ।

नई अंतःक्रिया संभावनाएं: बढ़ी हुई डेटा हैंडलिंग क्षमता उपयोगकर्ताओं के लिए AI के साथ बातचीत करने के पूरी तरह से नए तरीके खोलती है, जिससे अधिक जटिल और व्यापक कार्य संभव होते हैं।

बड़ी संदर्भ विंडो की चुनौतियाँ

लाभों के बावजूद, बड़ी संदर्भ विंडो चुनौतियाँ प्रस्तुत करती हैं:

कम्प्यूटेशनल लागत और शक्ति: पाठ के बड़े ब्लॉक्स को संसाधित करने के लिए काफी अधिक कम्प्यूटेशनल शक्ति, मेमोरी और समय की आवश्यकता होती है। संदर्भ की लंबाई को दोगुना करने से कम्प्यूटेशनल आवश्यकता चौगुनी हो सकती है।

विलंबता: संदर्भ लंबाई बढ़ने के साथ अनुमान धीमा हो सकता है, जो वास्तविक समय के अनुप्रयोगों के लिए समस्याग्रस्त है।

“तिनके के ढेर में सुई” की समस्या: जैसे-जैसे पाठ की मात्रा (“तिनके का ढेर”) बढ़ती है, एक मॉडल किसी विशिष्ट, महत्वपूर्ण विवरण (“सुई”) को पहचानने में संघर्ष कर सकता है। इसका ध्यान कमजोर पड़ जाता है, जिससे वह मुख्य तथ्य को नजरअंदाज कर देता है—जैसे कि 200 पन्नों की रिपोर्ट के भीतर किसी परियोजना की गंभीर विफलता के बारे में एक वाक्य को छोड़ देना। इससे मॉडल की विश्वसनीयता और सटीकता में भारी कमी आती है।

इस मुद्दे पर गहराई से जानने के लिए, इस पर आधारभूत पेपर देखें: https://arxiv.org/abs/2307.03172

क्षमताओं का विकास

समय के साथ संदर्भ विंडो के आकार में काफी वृद्धि हुई है, जो AI प्रणालियों में गहरी समझ और व्यापक स्थितिजन्य जागरूकता की दिशा में एक बड़ा कदम है। जबकि GPT-2 जैसे शुरुआती LLM लगभग 2,048 टोकन तक सीमित थे, आधुनिक मॉडलों ने अपनी क्षमताओं में विस्फोट देखा है।

आज, Anthropic के Claude 3 जैसे मॉडल 200,000-टोकन विंडो प्रदान करते हैं। OpenAI के GPT-4 Turbo और GPT-4o 128,000 टोकन तक पहुंचते हैं। Google Gemini 1.5 Pro में एक मानक 128,000-टोकन विंडो है, जिसका एक प्रायोगिक संस्करण 1 मिलियन टोकन तक जाता है, और शोध 10 मिलियन टोकन तक का परीक्षण कर रहा है। Magic AI जैसे प्रोजेक्ट्स तो 100 मिलियन टोकन का लक्ष्य रख रहे हैं। संदर्भ बढ़ाने की यह दौड़ AI क्षेत्र में नवाचार और प्रतिस्पर्धा का एक प्रमुख संकेतक है।

निम्नलिखित तालिका संदर्भ विंडो क्षमताओं के विकास को दर्शाती है:

| संदर्भ विंडो (टोकन) | रिलीज़ वर्ष | विवरण |

|---|---|---|

| GPT-4 Turbo | 2023 | अनुकूलित, कम लागत वाला संस्करण |

| GPT-4o (Omni) | 2024 | मल्टीमॉडल (पाठ, छवि, ऑडियो) |

| Claude 3 Opus | 2024 | विस्तारित संदर्भ, मजबूत तर्क |

| Claude 3.5/4 | 2024 | नवीनतम Anthropic मॉडल |

| Gemini 1.5 Pro | 2024 | मल्टीमॉडल, बड़ा संदर्भ |

| Gemini 2.0 / 2.5 Pro | 2024 | उन्नत क्षमताएं |

शक्ति और व्यावहारिकता का संतुलन

संदर्भ विंडो बड़े भाषा मॉडल की “याददाश्त” और समझ के लिए मौलिक है। इसका आकार, जो टोकन में मापा जाता है, सीधे तौर पर एक LLM की सुसंगत पाठ उत्पन्न करने और जटिल कार्यों को संभालने की क्षमता को प्रभावित करता है।

हालांकि बड़ी संदर्भ विंडो AI क्षमताओं को काफी बढ़ाती हैं, लेकिन वे लागत, प्रदर्शन और सुरक्षा से संबंधित पर्याप्त चुनौतियाँ लेकर आती हैं। भविष्य का LLM विकास इस महत्वपूर्ण घटक के अनुकूलन पर केंद्रित रहेगा, प्रसंस्करण शक्ति और व्यावहारिक उपयोगिता के बीच “स्वीट स्पॉट” की तलाश करेगा। इसलिए, संदर्भ विंडो को समझना वर्तमान और भविष्य के AI टूल्स का अधिकतम लाभ उठाने के इच्छुक किसी भी व्यक्ति के लिए महत्वपूर्ण है।

संदर्भ विंडो को समझना GPT Workspace के लिए विशेष रूप से प्रासंगिक है, क्योंकि यह सीधे तौर पर प्रभावित करता है कि हमारे वर्तमान मॉडल—GPT-4.1 और GPT-4o—एक साथ कितनी जानकारी याद रख और संसाधित कर सकते हैं। दोनों मॉडल 128,000 टोकन तक की पर्याप्त संदर्भ विंडो प्रदान करते हैं, जो उन्हें विस्तारित चर्चाओं, दस्तावेज़ विश्लेषण और जटिल वर्कफ़्लो के लिए अत्यधिक व्यावहारिक बनाता है। यह क्षमता उपयोगकर्ताओं को लंबे दस्तावेज़ों या अंतःक्रियाओं का उपयोग करने में सक्षम बनाती है, बिना बार-बार पिछला संदर्भ खोए, जो GPT Workspace में सुसंगत, उत्पादक सत्र बनाए रखने के लिए आवश्यक है।

Google Workspace में बड़ी संदर्भ विंडो का अनुभव करें। GPT Workspace इंस्टॉल करें और GPT-4o को 128k संदर्भ के साथ सीधे Google Docs, Sheets, Slides और Gmail में उपयोग करें।