Comprendere i Token OpenAI GPT: Una Guida Completa

Scopri il potere dei token OpenAI GPT in questa guida completa. Impara cosa sono i token, come contarli e come usarli per generare testo coerente e contestualmente rilevante con i modelli OpenAI GPT

I modelli OpenAI GPT si collocano tra i modelli linguistici più potenti disponibili oggi, con la capacità di generare testo altamente coerente e contestualmente pertinente. Questi modelli utilizzano i token come unità elementare per calcolare la lunghezza di un testo. Ma cosa sono esattamente i token e come funzionano? In questa guida, approfondiremo i dettagli dei token OpenAI GPT, discutendo la loro definizione, i metodi per contarli e le loro applicazioni pratiche.

Comprendere i Token OpenAI GPT

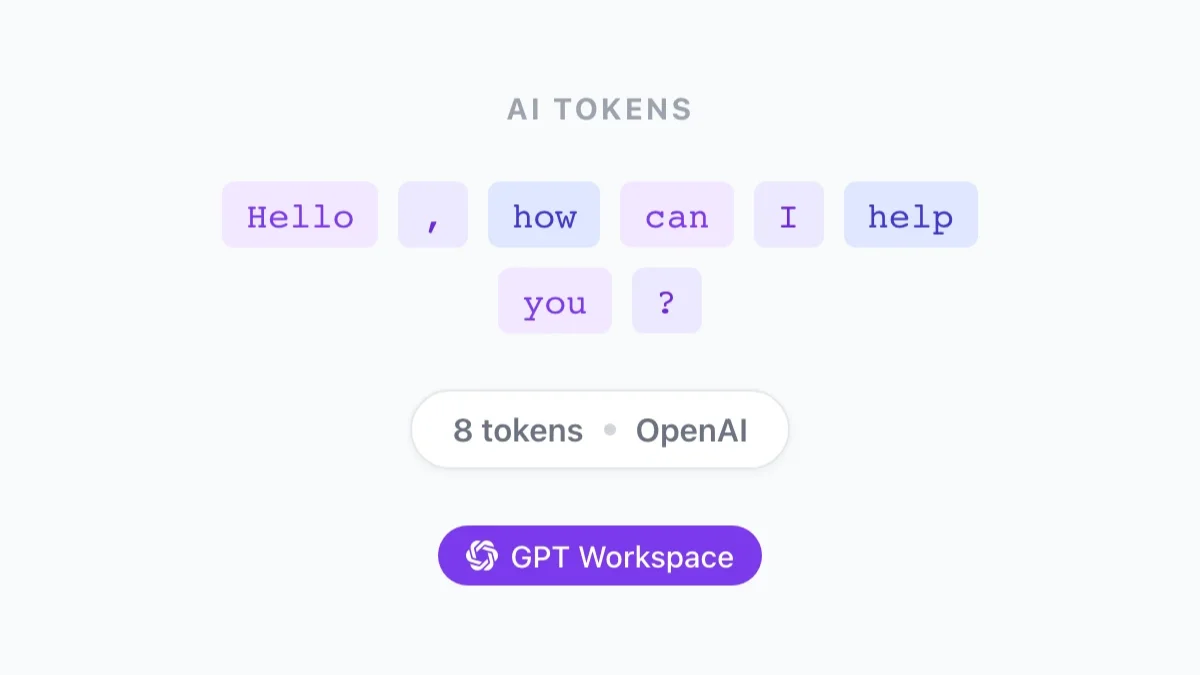

I token nel contesto dei modelli OpenAI GPT sono gruppi di caratteri che rappresentano l’unità fondamentale del testo. Questi token sono generati da un algoritmo tokenizzatore che separa il testo in segmenti più piccoli seguendo determinate regole, come spazi, segni di punteggiatura e caratteri speciali. I token a volte possono corrispondere a parole, ma non sempre, poiché il tokenizzatore considera tutti i caratteri, inclusi emoji, come potenziali token.

Contare i Token nel Tuo Testo

Per determinare il numero di token nel tuo testo, devi tokenizzarlo utilizzando un algoritmo tokenizzatore. OpenAI fornisce un tokenizzatore ufficiale che può assisterti in questo processo. Il numero di token prodotti dal tokenizzatore dipenderà dalla lingua e dal modello specifico utilizzato. Tuttavia, come linea guida generale, puoi utilizzare i seguenti rapporti parola-token:

- Inglese: 1 parola ≈ 1.3 token

- Spagnolo: 1 parola ≈ 2 token

- Francese: 1 parola ≈ 2 token

È cruciale riconoscere che i segni di punteggiatura sono contati come un token, mentre i caratteri speciali e le emoji possono essere contati rispettivamente da uno a tre token e da due a tre token.

Applicazione Pratica dei Token

Nei modelli OpenAI GPT, i token trovano il loro utilizzo in combinazione con il parametro max_tokens per la generazione del testo. Il parametro max_tokens specifica il numero massimo di token che dovrebbero essere generati in qualsiasi richiesta API. Il valore di max_tokens dovrebbe sempre rispettare il seguente vincolo: prompt_tokens + max_tokens ≤ limite del modello, dove prompt_tokens indica il numero di token nel prompt.

Il costo di un token dipenderà dal modello specifico utilizzato e viene fatturato per 1000 token. Ad esempio, il prezzo di 1000 token per ChatGPT è USD 0.0020, mentre per GPT-4 32k context è USD 0.1200.

Conclusione

I token sono un concetto fondamentale nei modelli OpenAI GPT, che rappresentano l’unità di base del testo utilizzata per generare testo contestualmente rilevante e coerente. Comprendendo la natura dei token e il loro utilizzo pratico, puoi sbloccare tutto il potenziale dei modelli OpenAI GPT e creare contenuti coinvolgenti che coinvolgono ed educano il tuo pubblico.

Vuoi utilizzare i modelli GPT direttamente in Google Workspace? Installa GPT Workspace — l’add-on per Google Workspace che porta OpenAI GPT in Google Docs, Sheets, Slides e Gmail gratuitamente.