Het Contextvenster: Het 'Geheugen' van Je AI

De Kern van LLM-begrip Wanneer je communiceert met een groot taalmodel (LLM) zoals ChatGPT, onthoudt het daadwerkelijk je eerdere berichten binnen het lopende gesprek. Dit vermogen is voornamelijk te danken aan

De Kern van LLM-begrip

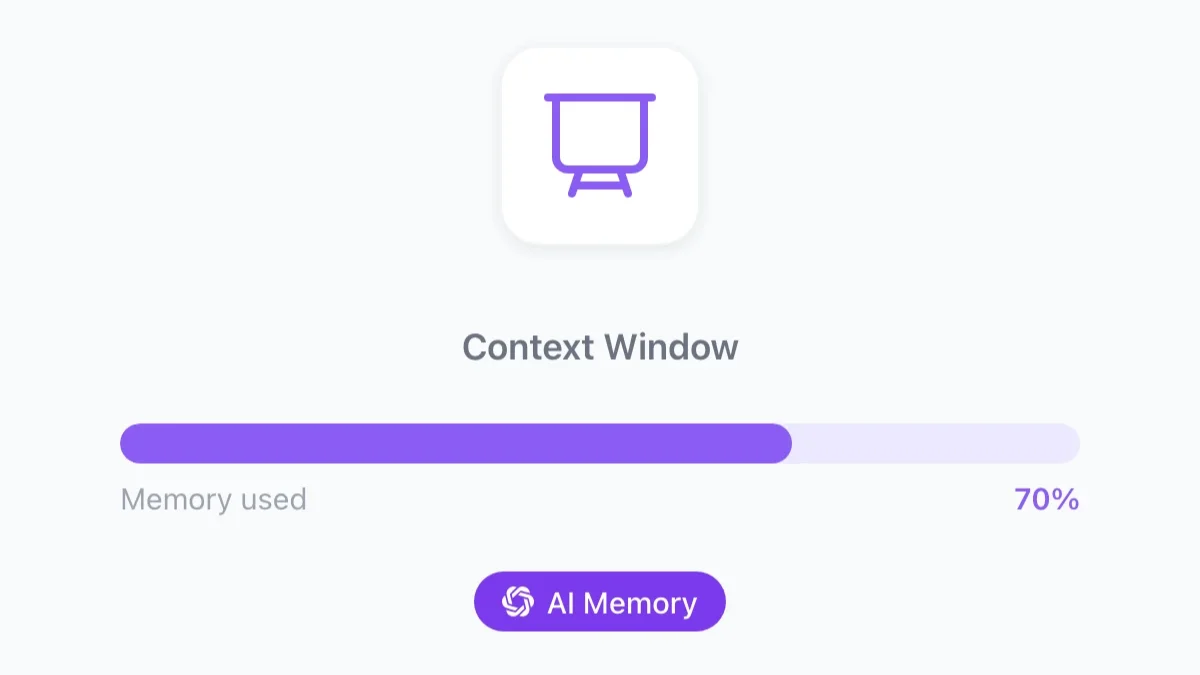

Wanneer je communiceert met een groot taalmodel (LLM) zoals ChatGPT, onthoudt het daadwerkelijk je eerdere berichten binnen het lopende gesprek. Dit vermogen is voornamelijk te danken aan wat het “contextvenster” wordt genoemd. Het werkgeheugen van het AI-model is vergelijkbaar met het kortetermijngeheugen van de mens of het RAM van een computer. Net zoals kortetermijngeheugen ons helpt informatie tijdelijk vast te houden en te verwerken, en RAM een computer in staat stelt snel toegang te krijgen tot de gegevens die het op dat moment nodig heeft, bepaalt het werkgeheugen van een AI hoeveel informatie het tegelijkertijd kan beheren. Deze capaciteit beperkt hoeveel context de AI kan overwegen bij het beantwoorden van vragen, net zoals ons kortetermijngeheugen of het RAM van een computer grenzen stelt aan wat gelijktijdig kan worden verwerkt.

Simpel gezegd, stel je het contextvenster voor als de hoeveelheid tekst die de AI tegelijkertijd kan “lezen” en “in gedachten kan houden”. Hoe groter dit venster, hoe meer details de AI kan onthouden uit je gesprek of kan analyseren uit lange documenten zonder te “vergeten” wat eerder is gezegd.

Wat is het Contextvenster?

In tegenstelling tot mensen die woorden verwerken, breken LLM’s tekst op in “tokens”. Een token kan een enkel teken, een deel van een woord, een heel woord of zelfs een korte zin zijn. Het woord “amoreel” kan bijvoorbeeld twee tokens hebben: “a” en “moreel”.

De grootte van het contextvenster wordt altijd gemeten in tokens. Gemiddeld is een Engels woord ongeveer 1,5 token. Het is belangrijk op te merken dat het contextvenster niet alleen wordt gebruikt voor je tekst; het omvat ook elementen zoals systeeminstructies (genaamd “system prompts”), aanvullende informatie voor Retrieval Augmented Generation (RAG) en opmaak. Een system prompt is een instructie aan de AI om te sturen hoe deze zich moet gedragen of reageren. Als je de AI bijvoorbeeld vraagt om op een professionele manier te antwoorden, is die opdracht een system prompt: “Beantwoord alle vragen alstublieft op een professionele en beleefde toon.”

Waarom is het zo belangrijk?

Een groter contextvenster biedt aanzienlijke voordelen voor LLM’s:

Verbeterde Informatieretentie: De AI kan meer details onthouden gedurende een gesprek, waardoor het niet “de draad kwijtraakt”.

Verwerken van Langere Teksten: Modellen kunnen veel grotere documenten, codebases of datasets analyseren en samenvatten, wat voorheen onmogelijk was.

Geavanceerd Redeneren: Meer context maakt nauwkeurigere, complexere en genuanceerdere antwoorden mogelijk. Het Gemini 1.5 Pro-model van Google kon bijvoorbeeld leren een kritisch bedreigde taal (Kalamang) te vertalen door de enige grammaticahandleiding ervan te lezen, en vertoonde een vertaalvermogen vergelijkbaar met dat van een mens.

Nieuwe Interactiemogelijkheden: De verhoogde gegevensverwerkingscapaciteit opent geheel nieuwe manieren voor gebruikers om met AI te interacteren, waardoor complexere en uitgebreidere taken mogelijk worden.

Uitdagingen van Grote Contextvensters

Ondanks hun voordelen brengen grote contextvensters uitdagingen met zich mee:

Rekenkosten en -vermogen: Het verwerken van grotere tekstblokken vereist aanzienlijk meer rekenkracht, geheugen en tijd. Het verdubbelen van de contextlengte kan de rekenbehoefte verviervoudigen.

Latentie: De inferentie kan langzamer worden naarmate de contextlengte toeneemt, wat problematisch is voor realtime-toepassingen.

Het “Speld in een Hooiberg”-Probleem: Naarmate het volume tekst (de “hooiberg”) groeit, kan een model moeite hebben om een specifiek, cruciaal detail (de “speld”) te lokaliseren. Zijn aandacht wordt verdund, waardoor het het sleutelfeit over het hoofd ziet—zoals het missen van een enkele zin over een kritiek falen van een project in een rapport van 200 pagina’s. Dit vermindert de betrouwbaarheid en nauwkeurigheid van het model drastisch.

Voor een diepere duik, zie het fundamentele artikel over dit probleem: https://arxiv.org/abs/2307.03172

De Evolutie van Capaciteiten

Contextvenstergroottes zijn in de loop van de tijd aanzienlijk gegroeid, wat een grote stap markeert naar dieper begrip en breder situationeel bewustzijn in AI-systemen. Terwijl vroege LLM’s zoals GPT-2 beperkt waren tot ongeveer 2.048 tokens, hebben moderne modellen een explosie in hun capaciteiten gezien.

Tegenwoordig bieden modellen zoals Anthropic’s Claude 3 een venster van 200.000 tokens. OpenAI’s GPT-4 Turbo en GPT-4o bereiken 128.000 tokens. Google Gemini 1.5 Pro heeft een standaard venster van 128.000 tokens, met een experimentele versie die tot 1 miljoen tokens gaat, en onderzoek test tot 10 miljoen tokens. Projecten zoals Magic AI mikken zelfs op 100 miljoen tokens. Deze race om de context te vergroten is een belangrijke indicator van innovatie en concurrentie in het AI-veld.

De volgende tabel illustreert de evolutie van contextvenstercapaciteiten:

| Contextvenster (tokens) | Uitgavejaar | Opmerkingen |

|---|---|---|

| GPT-4 Turbo | 2023 | Geoptimaliseerde, goedkopere versie |

| GPT-4o (Omni) | 2024 | Multimodaal (tekst, beeld, audio) |

| Claude 3 Opus | 2024 | Groot contextvenster |

| Claude 3.5/4 | 2024 | Uitgebreide context, sterk redeneervermogen |

| Gemini 1.5 Pro | 2024 | Nieuwste Anthropic-modellen |

| Gemini 2.0 / 2.5 Pro | 2024 | Multimodaal, groot contextvenster |

| Verbeterde capaciteiten |

Kracht en Praktische Bruikbaarheid in Balans Brengen

Het contextvenster is fundamenteel voor het “geheugen” en begrip van Grote Taalmodellen. De grootte ervan, gemeten in tokens, heeft direct invloed op het vermogen van een LLM om samenhangende tekst te genereren en complexe taken af te handelen.

Hoewel grotere contextvensters de AI-capaciteiten aanzienlijk verbeteren, brengen ze aanzienlijke uitdagingen met zich mee op het gebied van kosten, prestaties en beveiliging. Toekomstige LLM-ontwikkeling zal zich blijven richten op het optimaliseren van dit kritieke onderdeel, op zoek naar het “sweet spot” tussen verwerkingskracht en praktische bruikbaarheid. Het begrijpen van het contextvenster is daarom cruciaal voor iedereen die het meeste wil halen uit huidige en toekomstige AI-tools.

Het begrijpen van het contextvenster is vooral relevant voor GPT Workspace, omdat het direct beïnvloedt hoeveel informatie onze huidige modellen—GPT-4.1 en GPT-4o—tegelijkertijd kunnen onthouden en verwerken. Beide modellen bieden een aanzienlijk contextvenster van tot 128.000 tokens, waardoor ze zeer praktisch zijn voor uitgebreide discussies, documentanalyse en complexe workflows. Deze capaciteit stelt gebruikers in staat lange documenten of interacties te gebruiken zonder vaak eerdere context te verliezen, wat essentieel is voor het behouden van samenhangende, productieve sessies in GPT Workspace.

Ervaar grote contextvensters in Google Workspace. Installeer GPT Workspace en gebruik GPT-4o met 128k context direct in Google Docs, Sheets, Slides en Gmail.